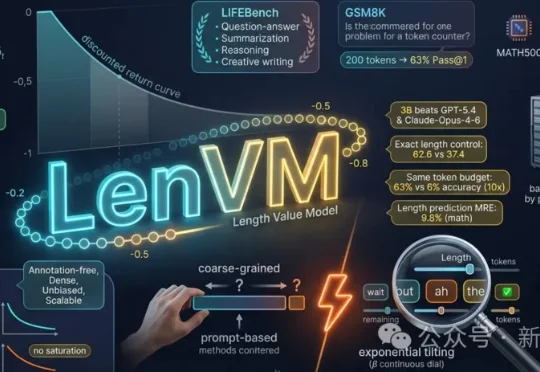

token级,精准控制生成长度:3B模型击败GPT 5.4、Claude

token级,精准控制生成长度:3B模型击败GPT 5.4、ClaudeLenVM将长度建模提升到token级别,开辟可扩展价值预训练的新维度——3B开源模型精确长度控制全面击败GPT-5.4、Claude-Opus-4-6等顶级闭源模型;相同token预算下推理准确率提升10倍(63% vs 6%);沿模型规模、数据量、采样数三轴无饱和scaling的value pretraining

搜索

搜索

LenVM将长度建模提升到token级别,开辟可扩展价值预训练的新维度——3B开源模型精确长度控制全面击败GPT-5.4、Claude-Opus-4-6等顶级闭源模型;相同token预算下推理准确率提升10倍(63% vs 6%);沿模型规模、数据量、采样数三轴无饱和scaling的value pretraining

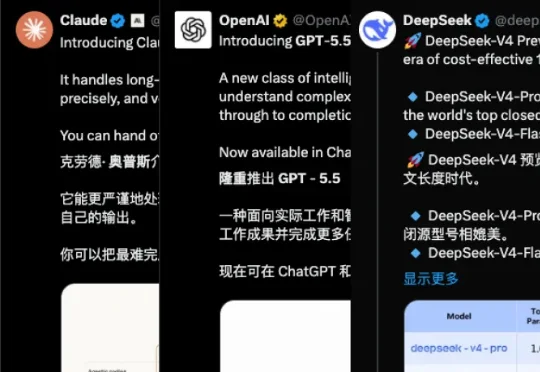

OpenAI 和 Anthropic 几乎在同一时间发布自己的提示词文档,在 OpenAI 官网,从 GPT-4.1 到 GPT 5.5,每次新模型发布都有一份完整的提示词指南,告诉我们怎么用新的模型。

四月真是如风驰电掣:Anthropic 发布了 Opus 4.7,OpenAI 发布了 GPT 5.5,最后,DeepSeek 更新了暌违已久的 V4。三家公司的发布通稿读起来都差不多:跑分又涨了,上下文更长了,推理更强了,代码能力又创了新高。

花了2天时间,在Moxt上搓了一个免费产品出来,叫 烤模。产品地址 bestmodel.cc。在烤模上,你能看到每个模型过去48小时里,真实用户在各个平台说了些什么。惊艳的案例、好评、差评、口碑走势、关键节点、多维度评分,全都有。

三月的Claude,不是在崩,就是在去崩的路上。状态页48条incident、major/critical事故窗口累计超44小时——这还是保守算法。更离谱的是,$200/月的Max顶配用户反映一小时不到就被限流,项目做到一半突然断供,零预警。推特上「60秒退订教程」疯传,开发者成群结队涌向Codex+GPT 5.4。但逃到对岸就安全了吗?OpenAI状态页显示:Codex三月也崩了7个小时。

要吊打 Gemini 的 GPT 5.2 在今天凌晨正式发布了,向所有用户推出。 上个月刚刚退订掉 ChatGPT Plus,转到 Gemini,这次需要因为 GPT-5.2 再回去吗? 看完下面这些网友真实的体验分享,还有 APPSO 的上手实测,或许能有个答案。

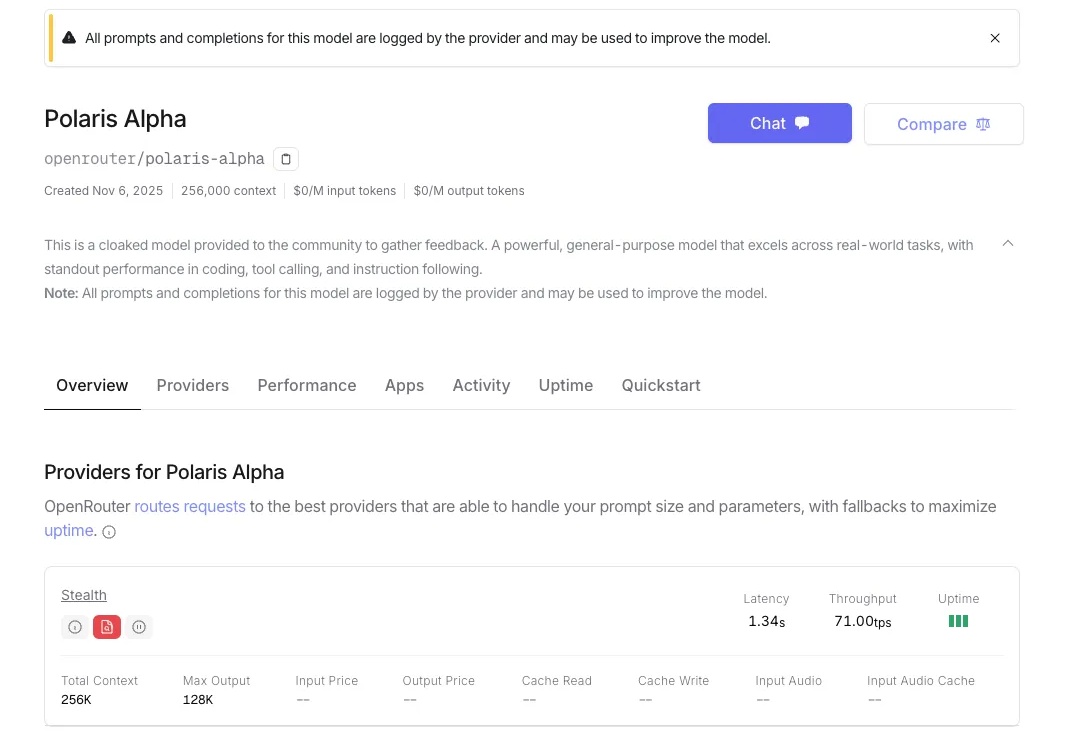

Gemini 3 还没影子,GPT 5.1 已经在路上。7 号深夜,OpenRouter 平台上线了一个全新的隐名模型。已经有眼尖动作快的网友尝鲜体验,并且认为这就是披着马甲的 GPT 5.1,暂名:Polaris Alpha。

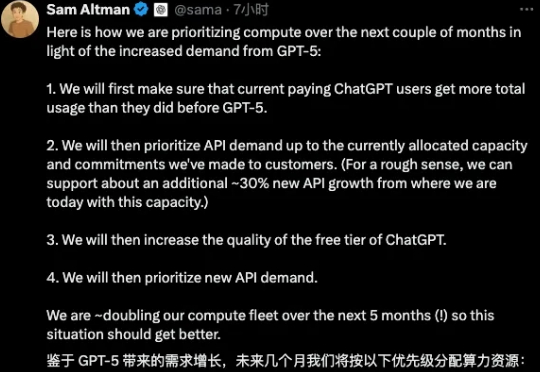

上周 GPT 5 的更新,除了激起对 4o 的想念,还激起了对 OpenAI 刀法的埋怨:优先付费用户,优先 API 支持…… 说吧,奥特曼,是不是就想逼我花钱升级?

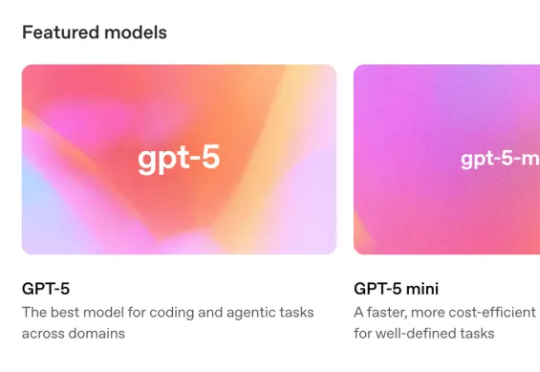

一个半小时之前,Ghat GPT 5,千呼万唤始出来,然后端了许多公司。刚刚研读了 GPT5 完整技术文档,先分享一下技术细节。刚刚研读了 GPT5 完整技术文档,先分享一下技术细节。

OpenAI CEO阿尔特曼40分钟深聊:GPT-5将至,AGI未定,AI硬件与5000亿算力项目揭秘。